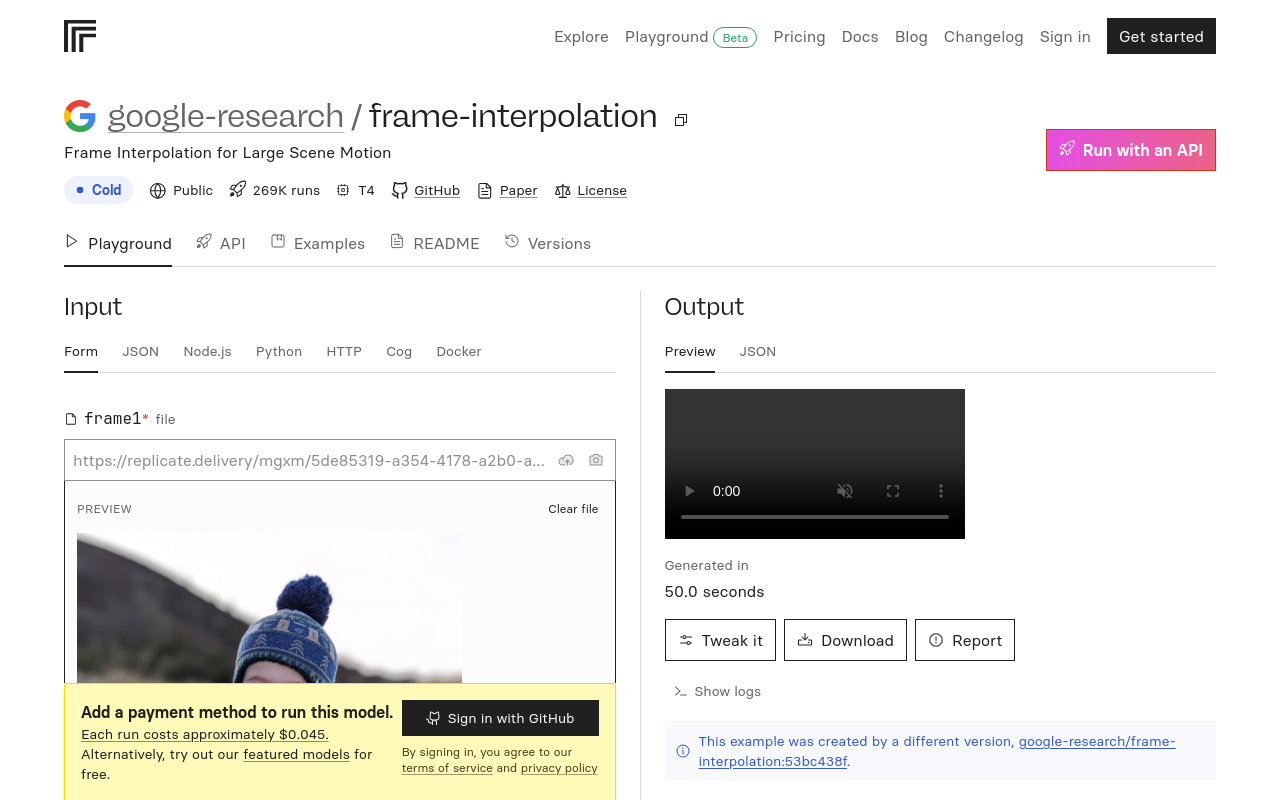

Replicate平台上的Frame Interpolation模型(https://replicate.com/google-research/frame-interpolation )由谷歌研究团队开发,专注于视频帧插值技术,即在两个输入视频帧之间生成高质量的中间帧,以平滑运动轨迹、消除画面闪烁,提升视频流畅度和连续性。

- 适用场景:

- 电影/游戏后期制作:优化高速镜头切换的视觉效果。

- 实时直播:增强低帧率视频的流畅度。

- 科学可视化:处理动态数据的高帧率需求。

技术原理

- 统一单网络架构:无需依赖额外预训练网络(如光学流或深度估计),直接通过多尺度特征提取和自适应卷积生成中间帧。

- 大场景运动优化:针对复杂运动场景设计,例如快速移动的物体或大范围视角变化。

- 输入输出要求:

- 输入:两帧相邻视频帧(支持图片格式)。

- 输出:可调整插值次数(1-8次/帧间隔),控制生成帧数及最终视频帧率。

使用方法与平台支持

- 操作流程:

- 访问Replicate平台并选择该模型。

- 上传两帧图片,设置插值次数(如2次生成1帧中间帧)。

- 模型自动运行并生成连贯视频,支持Nvidia T4 GPU加速。

- 部署方式:

- API调用:开发者可通过Python库或REST API集成到项目中。

- 低代码操作:非技术人员直接通过网页界面上传文件即可。

优势与限制

- 优势:

- 低门槛:无需配置深度学习环境,Replicate提供云端GPU资源。

- 开源免费:模型代码和API调用均免费开放(部分高频调用可能产生费用)。

- 高效性:在Nvidia T4硬件上预测速度快,适合实时处理需求。

- 限制:

- 输入帧需为连续且相邻,不支持跨帧插值。

- 输出视频分辨率受限于输入帧尺寸。

扩展应用案例

- 电影修复:将经典低帧率影片转换为高清流畅版本。

- 虚拟现实(VR):提升VR视频的帧率以减少眩晕感。

- 科研数据可视化:生成动态实验过程的高帧率动画。