9月28日,全球最大AI开源社区Hugging Face发布最新一期模型榜单,阿里巴巴通义大模型家族七款模型同时跻身全球前十,几乎实现“屠榜”。其中,刚刚开源的全模态大模型Qwen3-Omni凭借卓越的音视频处理能力与稳定的文本、图像性能,登顶全球开源模型榜首,标志着中国AI开源生态再次取得历史性突破。

一、七款模型齐入榜,阿里通义实现“开源霸榜”

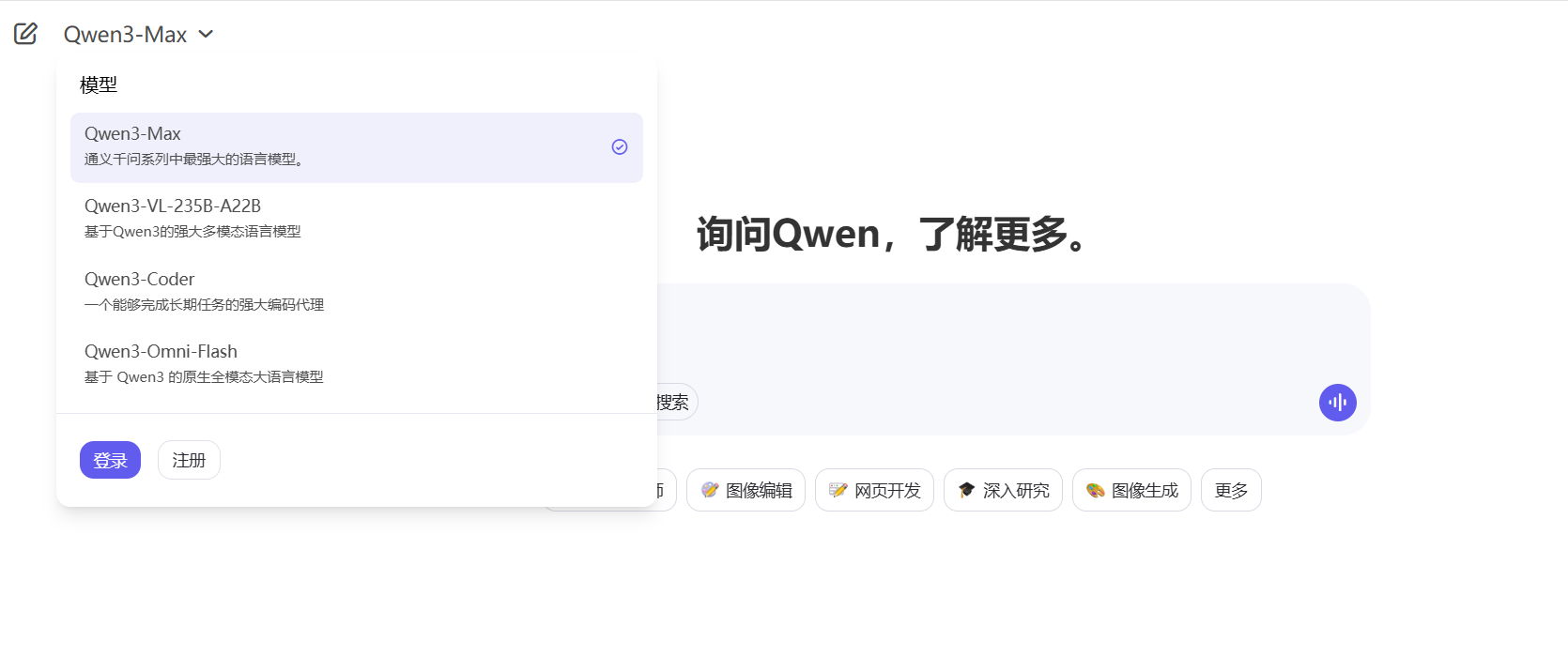

本次榜单中,阿里通义共七款模型入选全球前十,涵盖视觉理解、图像编辑、动作生成、深度研究等多个方向,展现出强大的模型矩阵能力。除Qwen3-Omni外,视觉理解模型Qwen3-VL、图像编辑模型Qwen-Image-Edit-2509、动作生成模型Wan2.2-Animate、深度研究Agent模型DeepResearch等也一同上榜,显示出通义大模型在多模态、多任务、多尺寸上的全面布局。

截至目前,阿里通义累计开源模型已超300款,全球下载量突破6亿次,衍生模型数量超过17万个,稳居全球第一,构建起庞大的开源模型生态体系。

二、Qwen3-Omni登顶:原生全模态架构实现技术突破

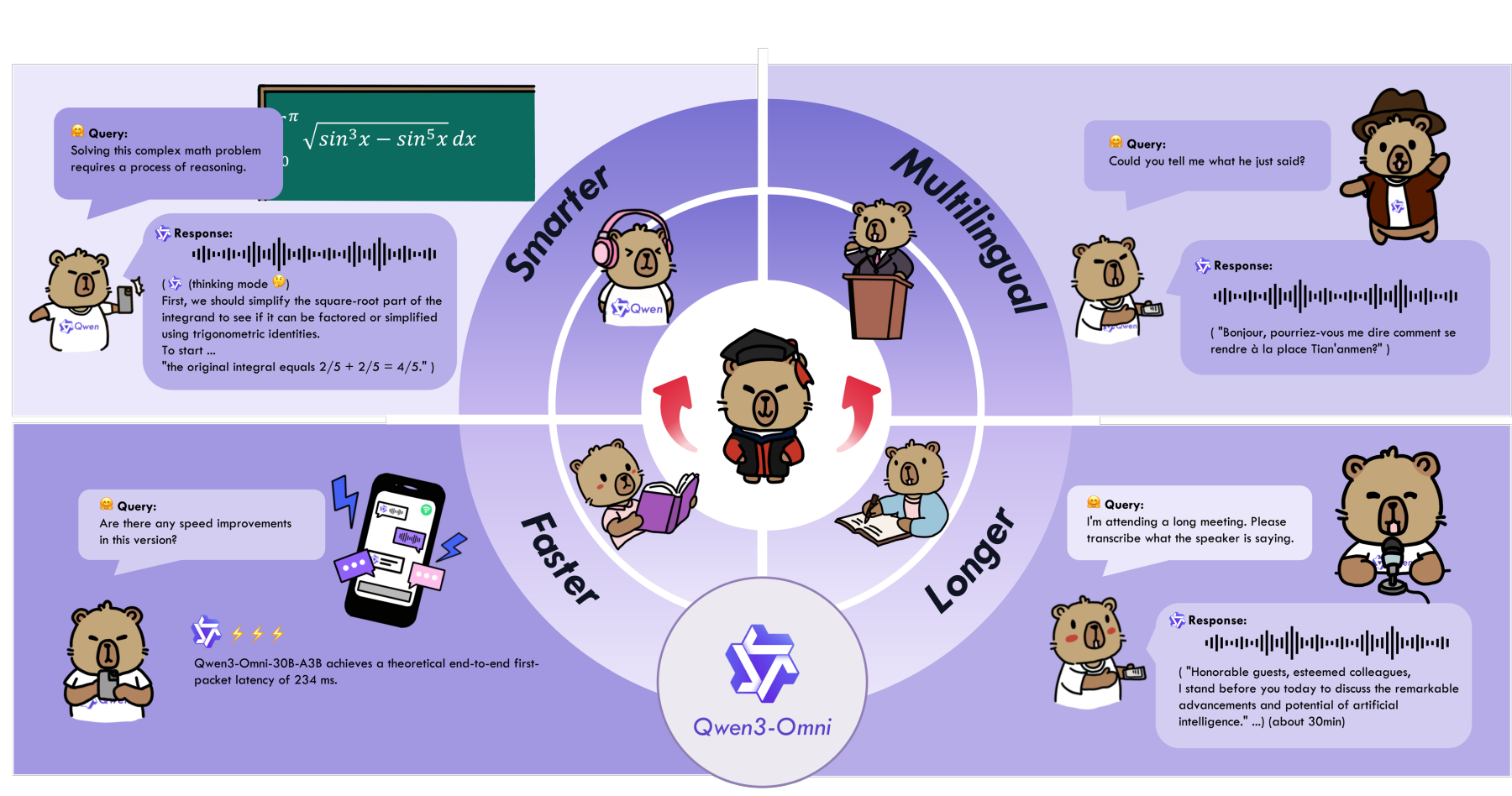

作为本次榜单的最大亮点,Qwen3-Omni是阿里最新发布的原生全模态大模型,具备文本、图像、音频、视频四种模态的统一处理能力。在36项音视频基准测试中,该模型斩获32项开源SOTA(最佳性能)与22项总体SOTA,性能超越谷歌Gemini-2.5-Pro、GPT-4o-Transcribe等顶级闭源模型。

Qwen3-Omni采用原生全模态架构,在预训练阶段即实现多模态数据融合,避免了传统模型“拼接式”架构带来的性能损耗。其音频对话延迟低至211毫秒,视频对话延迟为507毫秒,支持30分钟长音频理解与119种文本语言交互,具备极强的实时交互能力与多语言适应性。

三、从“能用”到“好用”,全模态模型重塑AI交互体验

Qwen3-Omni的发布不仅是技术指标的突破,更意味着AI交互方式的全面升级。过去,用户需通过多个模型协同完成复杂任务,如视频理解、语音转写、图像识别等,而现在仅需一个Qwen3-Omni即可实现“听、说、写、看”一体化处理,大幅提升效率与体验。 该模型已支持function call、system prompt定制、个性化语音生成等功能,适用于智能客服、车载交互、内容创作、教育辅助等多个场景。阿里表示,未来Qwen3-Omni将广泛应用于智能眼镜、手机、车载终端等设备,推动AI真正走向“无处不在”。

四、中国开源力量崛起,全球AI格局悄然生变

此次阿里通义七款模型集体登榜,不仅是中国AI技术实力的集中体现,也反映出中国在全球开源AI生态中的主导地位。早在2025年初,Hugging Face榜单前十中便有九成以上为Qwen衍生模型,通义千问已成为全球最大开源模型族群。

业内专家指出,阿里通义通过持续开源、技术革新与社区共建,正在打破西方在AI大模型领域的技术垄断,推动全球AI技术向更加开放、普惠的方向发展。随着Qwen3-Omni等全模态模型的成熟,中国AI正从“跟随者”转变为“引领者”。

AD:精心整理了2000+好用的AI工具!点此获取