-

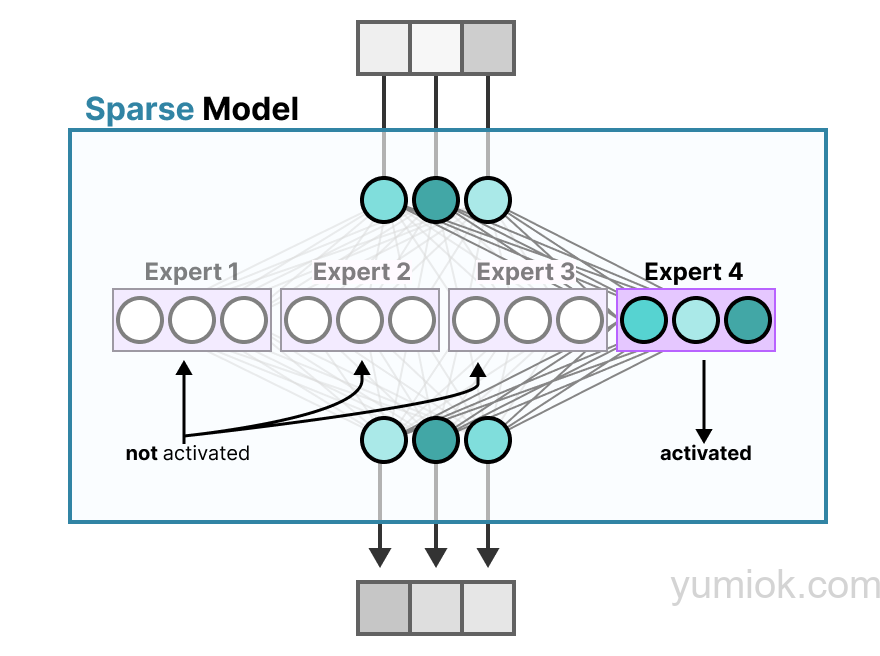

DeepSeek-R1爆火背后:混合专家架构与Transformer架构的创新融合

近期,DeepSeek-R1凭借其强大的性能和广泛的应用场景迅速走红,成为人工智能领域的一大亮点。作为一款基于混合专家(MoE)架构和优化的Transforme... -

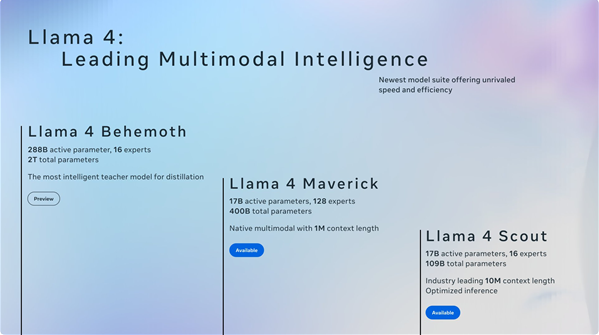

Meta 发布 Llama 4 大模型:混合专家架构引领 AI 新时代

Meta 公司推出了其最新的开源人工智能模型 Llama4,标志着其在人工智能领域的又一重大进展。Llama4分为两个版本,分别命名为 Scout 和 Mave... -

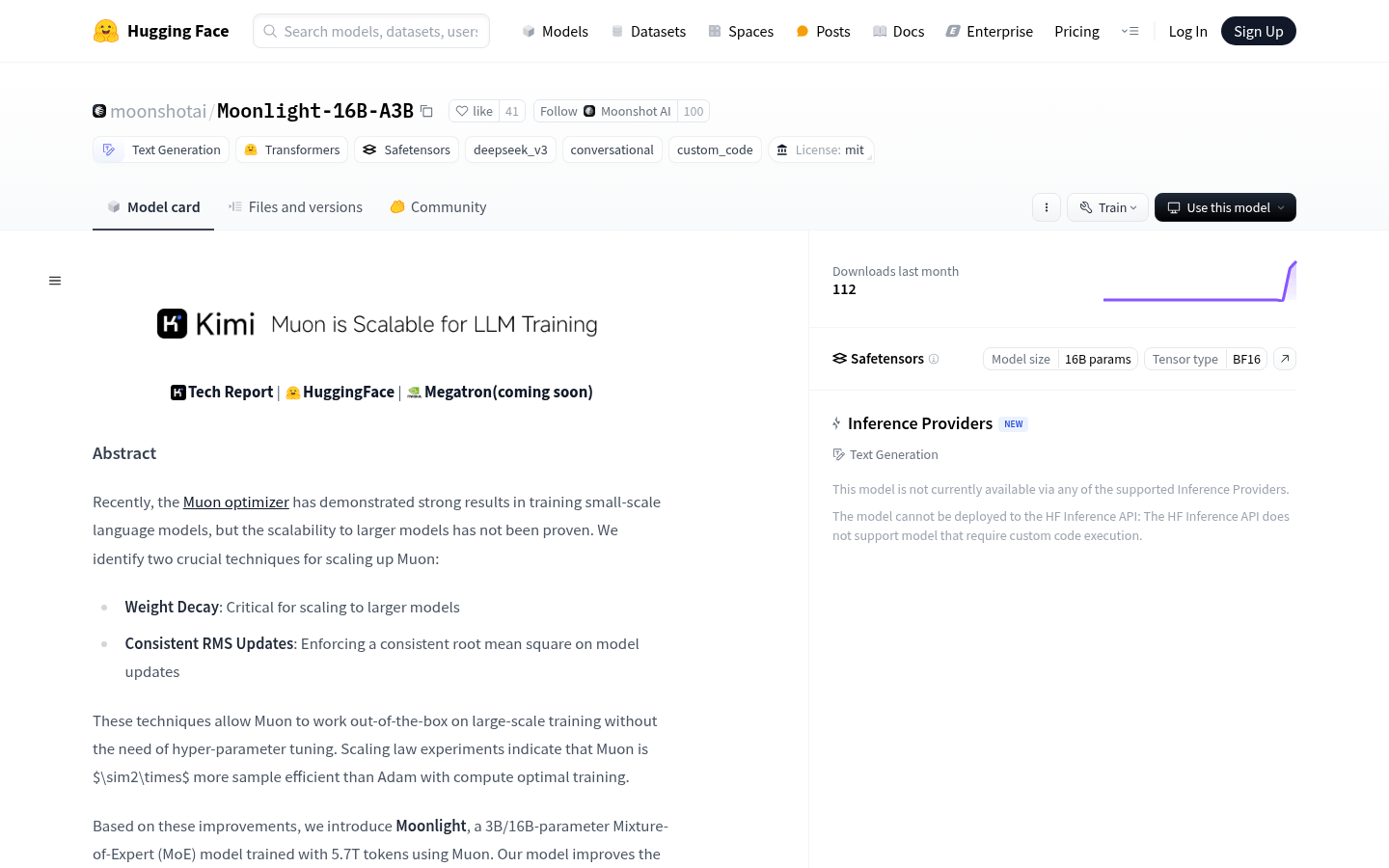

Moonlight 16B A3B

使用场景使用 Moonlight-16B-A3B 生成高质量的代码片段,提高开发效率。在多语言对话场景中,利用该模型实现流畅的对话生成。通过预训练模型进行文本生...