使用场景

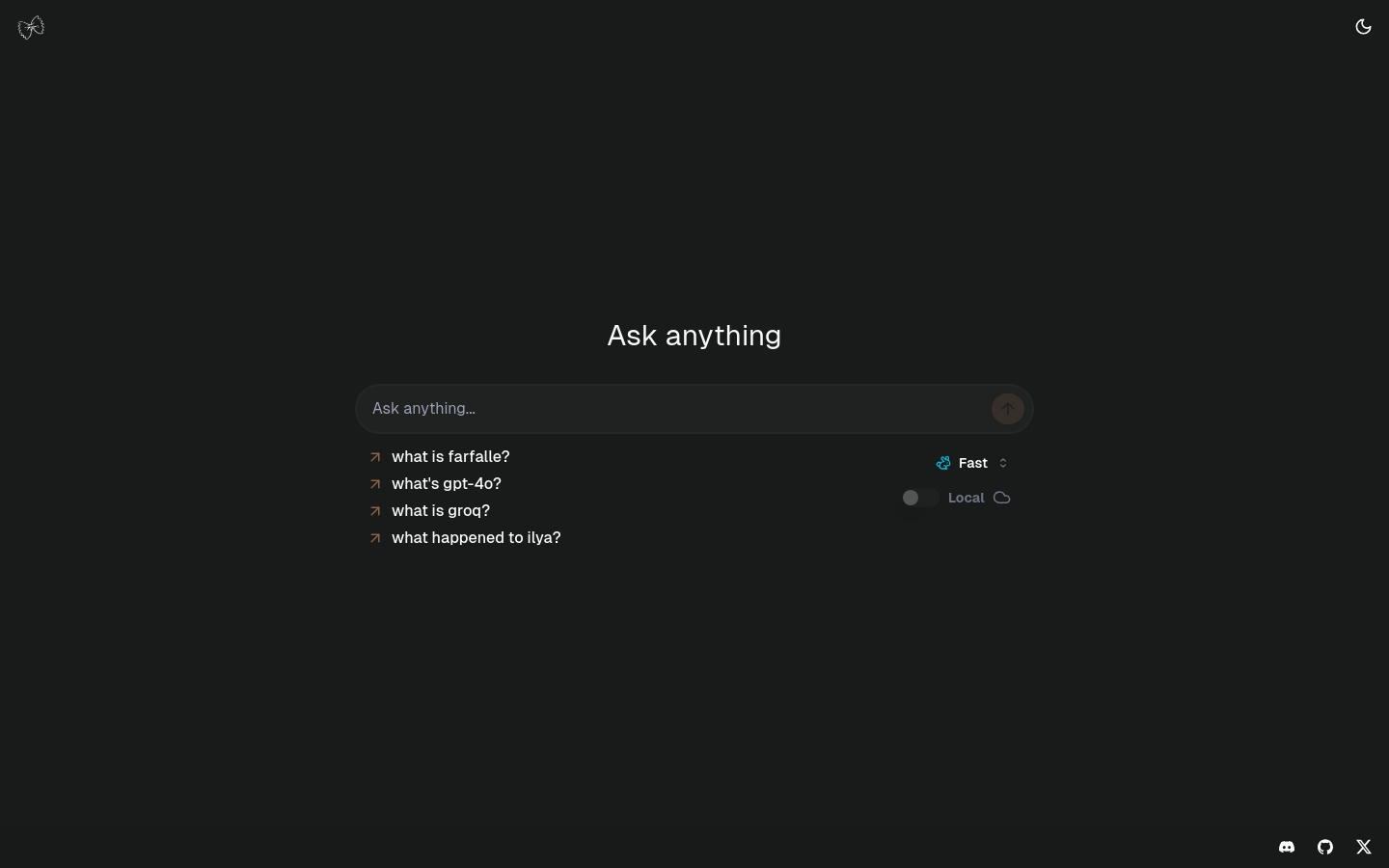

开发者可以利用Farfalle创建个性化的AI搜索引擎。

企业可以部署Farfalle来提供内部搜索服务,提高员工的工作效率。

教育机构可以利用Farfalle作为教学工具,帮助学生更好地获取信息。

产品特色

支持本地运行大型语言模型如llama3、gemma、mistral。

支持云模型,如Groq/Llama3、OpenAI/gpt4-o。

提供Docker部署设置,方便用户部署。

集成了Tavily搜索API,无需外部依赖。

使用Logfire进行日志记录。

使用Redis进行速率限制。

提供详细的自定义设置文档。

使用教程

首先,确保安装了Docker和Ollama(如果运行本地模型)。

下载支持的模型之一:llama3、mistral或gemma。

启动Ollama服务器:ollama serve。

获取Tavily、OpenAI(可选)和Groq(可选)的API密钥。

克隆Farfalle仓库到本地。

在.env文件中添加必要的环境变量。

使用Docker Compose运行容器。

访问http://localhost:3000来查看应用程序。