使用场景

在学术研究中用于复杂推理任务,如数学问题求解

为企业提供智能客服解决方案,生成高质量对话内容

在编程辅助工具中生成代码片段和逻辑建议

产品特色

支持多种文本生成任务,如对话、代码生成、数学推理等

采用强化学习技术,优化推理能力和生成质量

基于 Qwen-14B 蒸馏,性能优于同级别模型

支持最大生成长度达 32,768 tokens,满足复杂任务需求

提供 OpenAI 兼容 API,方便开发者集成和使用

使用教程

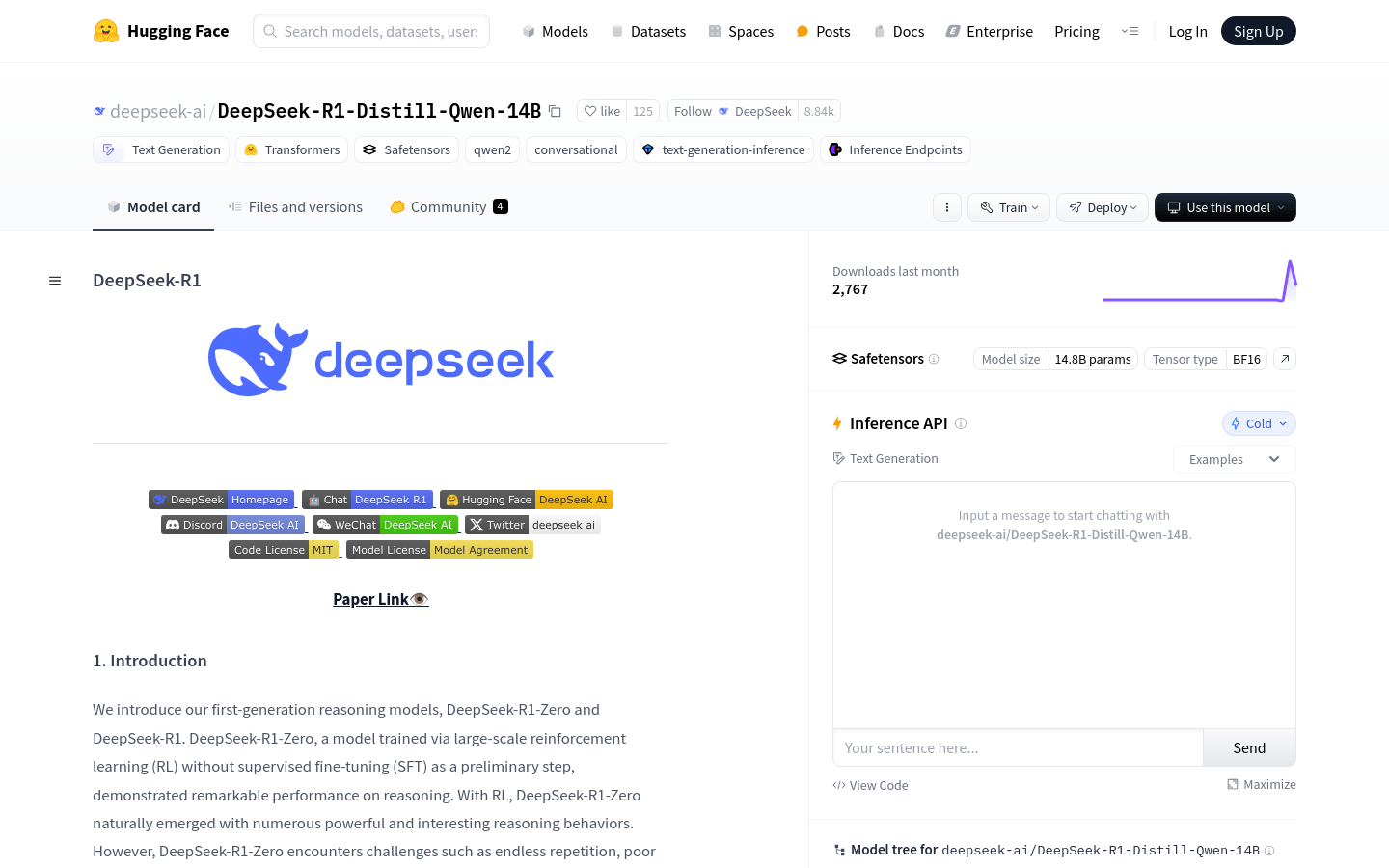

1. 访问 Hugging Face 官方页面,下载 DeepSeek-R1-Distill-Qwen-14B 模型文件。

2. 安装必要的依赖库,如 Transformers 和 Safetensors。

3. 使用 vLLM 或其他推理框架加载模型,并设置合适的参数(如温度、最大长度等)。

4. 输入任务相关的提示(Prompt),模型将生成相应的文本输出。

5. 根据需求调整模型配置,优化生成效果。