使用场景

研究人员利用 LLaSA_training 模型开发智能语音助手,提升语音交互体验

开发者使用该项目训练的模型为在线教育平台开发语音播报功能,提高教学效率

企业利用 LLaSA_training 模型优化客服系统的语音合成模块,提升客户满意度

产品特色

支持基于 LLaMA 的语音合成模型训练,提供高效的计算优化方案

兼容多种开源数据集,如 LibriHeavy、Emilia 等,数据总量达 160,000 小时

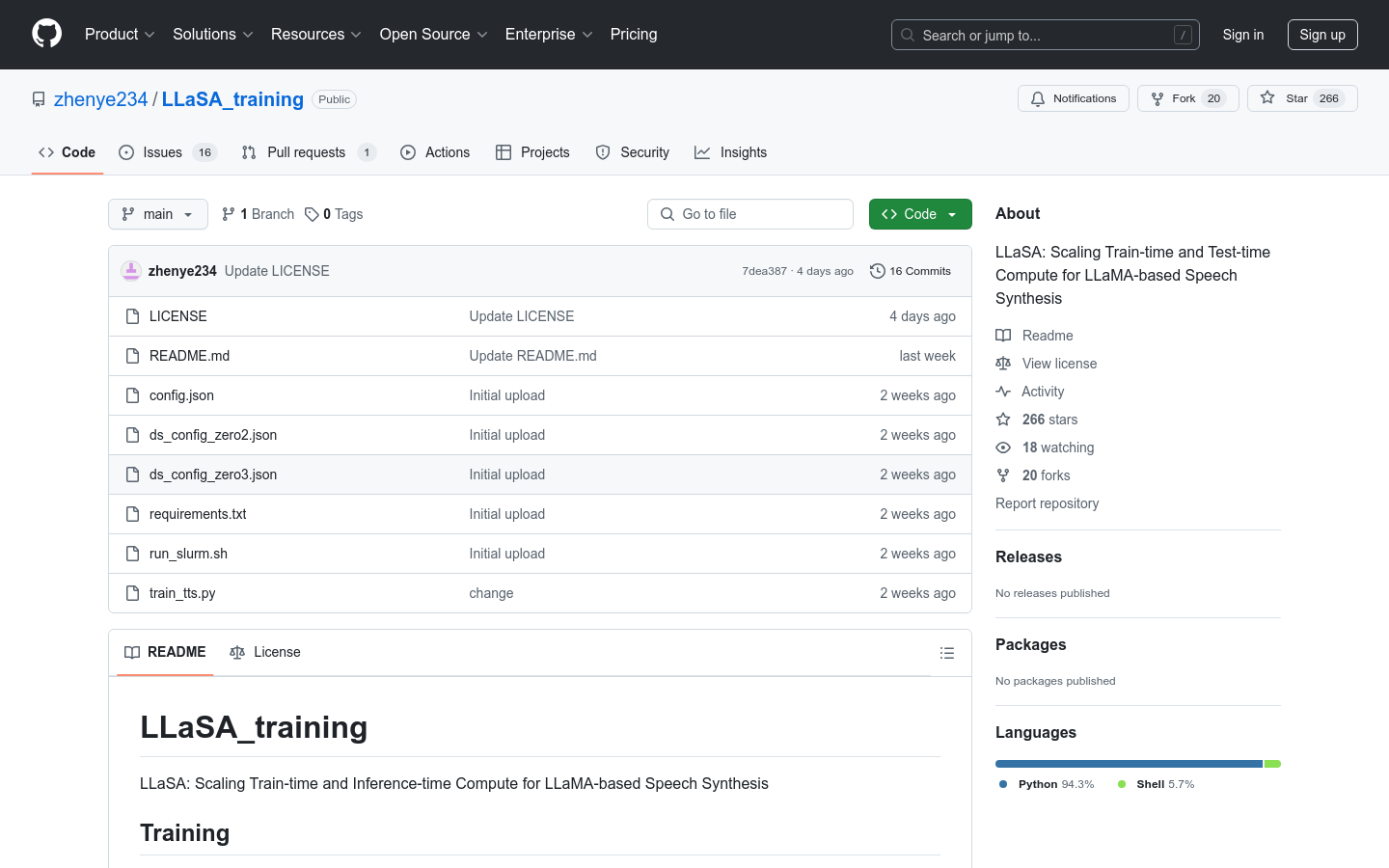

提供多种训练配置文件(如 ds_config_zero2.json 和 ds_config_zero3.json),满足不同训练需求

支持通过 Slurm 调度系统进行分布式训练,提升训练效率

可在 Hugging Face 上直接使用相关模型,如 Llasa-3B、Llasa-1B 和 Llasa-8B

使用教程

1. 克隆该项目仓库到本地:`git clone https://github.com/zhenye234/LLaSA_training.git`

2. 下载所需的开源数据集,如 LibriHeavy 和 Emilia 等,或准备自己的数据集

3. 根据需求选择合适的配置文件(如 ds_config_zero2.json 或 ds_config_zero3.json)

4. 使用命令 `torchrun --nproc_per_node=8 train_tts.py config.json` 或通过 Slurm 调度系统运行训练脚本

5. 训练完成后,可在 Hugging Face 上直接使用训练好的模型进行语音合成